InternLM大语言模型-

| 版本: -- | 交付方式: 镜像 |

| 适用于: Linux | 上架日期: 2025-04-22 03:32:01 |

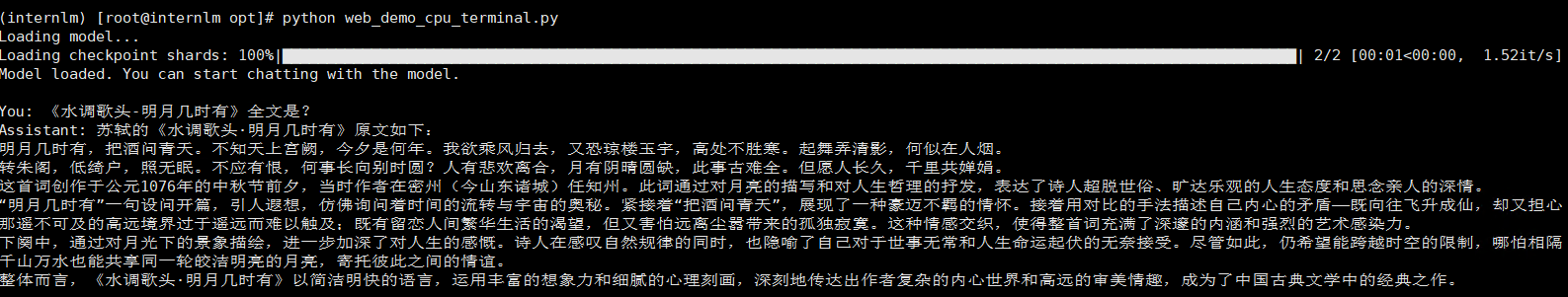

InternLM2.5-1.8B-Chat 是上海人工智能实验室推出的高性能对话模型,基于 InternLM2.5 架构开发,参数规模为 18 亿,支持中英文长文本理解与推理任务。其采用动态位置编码和增量预训练策略,优化了长上下文处理能力(如支持 32K 至 200K 超长文本),并通过条件在线强化学习(COOL RLHF)实现与人类偏好对齐。模型支持 LMDeploy 高效部署(含 API 服务与量化压缩),适配移动端(如安卓)及微调工具链(如 XTuner),适用于智能对话、代码生成等多场景。

本商品基于arm架构,Huawei Cloud EulerOS 2.0 64bit系统,提供internlm2_5-1_8b-chat模型。

建议的系统要求如下:

• CPU: 4 GHz或更高

• RAM : 16 GB或更大

• Disk: 至少100 GB

我们提供此 镜像 供您选择。此镜像是免费的,如果您选择此镜像,即表示您完全同意此声明。

我们不对镜像提供支持,也不提供任何明示或暗示的保证、保证或陈述,也不对由此造成的损失承担任何责任。

如果您在使用过程中遇到操作系统问题,可以联系操作系统厂商或开源社区寻求技术支持。