AI开发平台MODELARTS-PyTorch:PyTorch框架启动原理

PyTorch框架启动原理

规格和节点个数

下面以选择“GPU: 8*GP-Vnt1 | CPU: 72核 | 内存:512GB”规格为例,介绍在单机和分布式场景下ModelArts规格资源的分配情况。

单机作业时(即选择的节点数为1),ModelArts只会在一个节点上启动一个训练容器,该训练容器独享节点规格的可使用资源。

分布式作业时(即选择的节点数大于1),worker的数量和创建作业时选择的节点数一致,每个worker将被分配到所选规格对应的计算资源。例如计算节点个数为“2”时,将启动2个worker,每个worker拥有“GPU: 8*GP-Vnt1 | CPU: 72核 | 内存:512GB”的计算资源。目前PyTorch引擎仅支持GPU和CPU类型的规格,如果需要使用昇腾规格,请参考Ascend-Powered-Engine。

网络通信介绍

- 单机作业不涉及网络通信情况。

- 分布式作业的涉及网络通信则可以分为节点内网络通信和节点间网络通信。

节点内网络

使用NVLink和共享内存通信。

节点间网络

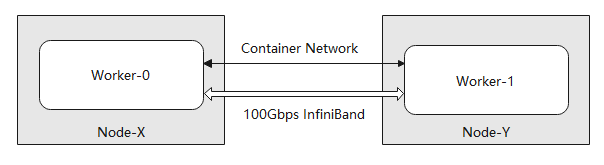

当计算节点个数大于1时,将启动PyTorch引擎分布式训练模式。PyTorch引擎的分布式模式如下图所示,worker之间可通过容器网络和100Gbps的InfiniBand网卡或RoCE网卡通信,部分规格中使用RoCE网卡,将在规格中额外提示。其中,容器网络可以通过DNS域名通信,但网络性能一般,可用于点对点小规模通信需求;InfiniBand网络和RoCE网络为高性能网络,可用于集合通信等分布式训练的场景。

- ModelArts分布式训练_分布式训练介绍_分布式调测

- ModelArts模型训练_模型训练简介_如何训练模型

- ModelArts是什么_AI开发平台_ModelArts功能

- ModelArts自定义镜像_自定义镜像简介_如何使用自定义镜像

- AI训练加速存储_高性能数据存储_AI数据存储内存不足怎么办

- TMS开发_金蝶TMS系统_TMS技术系统_信息化管理_视频

- ModelArts推理部署_创建AI应用_自定义镜像规范-华为云

- GaussDB原理_GaussDB数据库原理_高斯数据库原理-华为云

- 深圳MES系统_MES框架_MES集成

- MapReduce服务_什么是Yarn_如何使用Yarn

下载AI开发平台MODELARTS用户手册完整版

下载AI开发平台MODELARTS用户手册完整版